Ante una avalancha como la que está provocando la IA generativa se hace difícil encontrar el equilibrio. La industria de las TI se contorsiona para acertar a la vista de herramientas que prometen un gran potencial, pero a la hora de la verdad resultan ser poco predecibles. Este es un ejercicio marcado a fuego por la urgencia, la necesidad de no quedarse atrás y la ilusión de controlar el retorno de la inversión de capital (ROIC). Ahí aparecen las lagunas, porque uno de los campos donde los estragos son notables es, cómo no, la ciberseguridad. Y se confirma la consciencia de que la IA, aparte de sus méritos, ensancha peligrosamente la superficie de ataque en los sistemas de información.

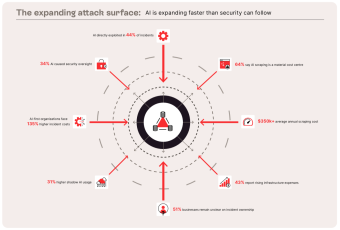

¿A qué viene este preludio que en 700 caracteres no ha nombrado el sujeto? Viene a que Fastly, empresa proveedora de CDN (content delivery network), ha publicado un informe que profundiza en la tesitura de que los medios existentes de protección no son capaces de sobreponerse al ritmo de adopción que lleva la IA en las empresas He aquí, para empezar, las fuentes de esa expansión de la superficie de ataque.

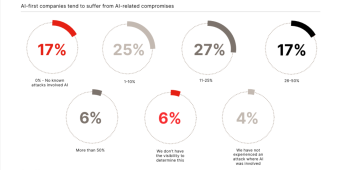

El título del documento roza la provocación, pero resuta eficaz: The AI Speed Tax . Así denominan los autores al supuesto peaje que han de pagar las compañías por su seguridad las compañías que se apresuren en implementar la IA y que Fastly cataloga como AI First. La velocidad de adopción, unido al célebre mantra Move fact, break things, ha propiciado un aumento en el número de amenazas para las empresas.

La conclusión del informe no deja de ser un tanto facilona. No se debe priorizar – dice – la adopción de la IA a toda costa pasando por encima de la seguridad. Bien dicho, pero a ver quién se lo dice al responsable de una empresa que ve cómo otras se le adelantan y el mercado les premia por ello. Lo que viene a decir el informe es que lo lógico hubiera sido pensarlo de antemano, pero abundan quienes no lo han hecho. La tentación de presentarse como pionero puede ser irresistible, incluso en departamentos de TI que deberían estar curados de espanto. Por cierto, el informe de Fastly se apoya en encuestas a 2.000 responsables de tomar decisiones en materia de ciberseguridad, clasificados en tres bloques: América, Europa y Asia-Pacífico.

Si algo tienen claro los encuestados es que la IA introduce mayor complejidad en los sistemas que están a su cargo. No es que sea nada nuevo : ya se sabe que supone más código y más infraestructura que proteger. A lo que suman que los nuevos agentes de IA y las automatizaciones que amplían los accesos a información sensible y procesos críticos. Por consiguiente, son accesos necesarios, pero las consecuencias pueden tener su lado oscuro.

Aunque el informe no aporta una correlación directa entre lo anterior y el aumento de los errores de software observados, sólo hay que trazar una línea mental entre ellos. El año pasado, estos fallos provocaron el 40% de los incidentes de seguridad, siete puntos porcentuales más que en 2024. Ya son la principal causa de estos problemas, adelantando a los ataques externos, que representan el 39%. En tercer lugar, siguen las configuraciones incorrectas, culpables del 29% del total (cuatro puntos más que un año antes).

De este panorama se desprende que los fallos de seguridad están motivados, cada vez más, por el código con que han programado los sistemas o por la manera en que se ha configurado la infraestructura, algo que suele automatizarse mediante código . Las amenazas sofisticadas procedentes del exterior pierden protagonismo, pero el documento deja la sensación de que no ocurre porque se hayan frenado sino porque otras vías son más explosivas. El siguiente gráfico ahorrará lectura.

En el uso de la IA dentro de las empresas, el análisis distingue dos tendencias. Una de ellas consiste en el empleo de herramientas que no han sido autorizadas por el departamento de TI, pero son usadas por los trabajadores gracias a que la cultura de la empresa fomenta el uso de la IA o, al menos, no lo controla con directrices firmes. Esto es un quebradero de cabeza para los equipos de seguridad, porque no tienen capacidad para monitorizar su actividad. Quizá sea más perjudicial el segundo bloque, compuesto por las herramientas que sí están autorizadas.

¿Esto es aceptable en organizaciones que presumen de estar bien estructuradas? Pues al parecer sí, según el informe. Normalmente – es un hallazgo curioso – el software de IA autorizado por los departamentos de TI suele recibir permisos más generosos, supuestamente para aprovechar al máximo sus capacidades. No estaría mal pensado si no fuera porque así se agrava un problema clásico dentro de las empresas, la gestión de las identidades y los accesos a sus sistemas. Allí donde había peligro – o error de juicio – se hace manifiesto en un contexto en el que se dan privilegios a herramientas dotadas de mecanismos de automatización. Una vez más, resulta que una adopción más rápido – o menos reflexiva, si se quiere – puede traer consecuencias inesperadas.

La introducción más frecuente de elementos de IA también provoca una confusión en torno a las responsabilidades. El informe encargado por Fastly recoge que el 51% de las compañías AI First no tiene claro quién debe dar respuesta a los incidentes. Por serio que esto parezca, entre las empresas que se han precipitado, sólo el 23% tiene claro cómo actuar ante esa emergencia. El enredo se origina – es la tesis del informe – porque actualmente los equipos no están compuestos sólo por personas, sino que conviven con agentes de IA ejecutándose de forma autónoma y con alguna competencia para tomar decisiones por su cuenta.

Esta dilución de la responsabilidad convencional que se centraliza en un grupo reducido de personas, se añade a que en muchas empresas no hay conocimiento específico acerca de la seguridad de la IA, un campo todavía inmaduro.

Las empresas con adopción temprana de la IA asumen de hecho otro riesgo: se exponen a tardar más en recuperarse tras un incidente de seguridad. De media, emplean 6,8 meses, es decir 80 días más que aquellas que no priorizan la IA. Otra consecuencia señalada por el informe es que esas situaciones (sic) resultan más costosas a las pioneras, un 135% más.

El informe apenas se ocupa de España – “nacionalizar” conclusiones no siempre es útil – pero sí dice que el impacto en 2025 fue mayor que en otros países: un 35% de las compañías españolas consultadas reconocieron que en su incidente de seguridad más reciente, la IA fue explotada de forma directa, algo que sólo ocurrió al 16% de las empresas que optaron por esperar. Un ámbito que suele olvidarse cuando se habla del impacto de la IA, pese a que ya provoca trastornos, es la extracción de datos, el llamado scrapping, Más de dos terceras partes de las empresas encuestadas por encargo de Fastly destacan este factor, que les obliga a absorber un aumento medio de 350.000 dólares en sus costes de infraestructura. No es sólo una cuestión económica: el tráfico que procede de rastreadores automáticos provoca interrupciones de servicio, según un 40% de los encuestados, y un deterioro en la experiencia de los clientes, según el 29%. No es de extrañar. La saturación de los sistemas lleva a tiempos de carga más lentos, a peor rendimiento de algunas funciones y, por ende, al malestar entre los usuarios.

¿Qué hacen las empresas ante este escenario? En general, han reorientado sus presupuestos de seguridad hacia la protección de datos y la privacidad, pero también a contratar seguros que garanticen la cobertura de pérdidas por incidentes de este tipo. Se abren paso las soluciones WAAP (Web Application and API Protection) que postulan una protección integral, mitigación de ataques y el establecimiento de cortafuegos, así como la gestión de bots. De más está decir que estas soluciones forman parte del arsenal de Fastly.

No todo son malas noticias. El tiempo medio de recuperación ha disminuido de 7,34 a 6,08 meses. También se han moderado las pérdidas económicas, del 2,68% de los ingresos anuales frente al 2,98% del 2024. Bienvenido pero magro consuelo ante la magnitud del problema. Las empresas harían bien en anticiparse- recomienda el informe en sus conclusiones – evitando las herramientas de IA que no hayan sido aprobadas debidamente, pero aun así no tendría sentido que lo hicieran sin promover medidas que proscriban todo uso de la IA susceptible de provocar una expansión de la superficie de ataque.

La receta es aparentemente sencilla, sólo que su cocción exige que la digestión de la IA se haya planificado y ejecutado con plena comprensión de todo lo que implica. ¿Se entenderá el mensaje?

[informe de Pablo G. Bejerano]